顶级大佬齐声呼吁,暂停超级智能研发的深度思考

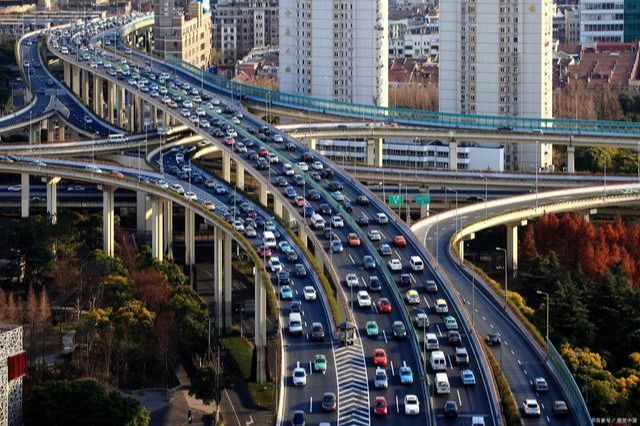

随着科技的飞速发展,人工智能(AI)和超级智能的研发成为了全球科技巨头和科研机构竞相追逐的焦点,近期,一场前所未有的呼声在科技界引起了广泛关注——顶级大佬们齐声呼吁暂停超级智能的研发,这一声音背后,究竟隐藏着怎样的担忧与思考?本文将就此话题展开深入探讨。

顶级大佬的呼吁背景

近年来,随着AI技术的不断突破,超级智能的研发成为了科技界的一大热点,随着这一领域的深入探索,越来越多的科技巨头和科研机构开始对超级智能的潜在风险表示担忧,从全球范围来看,顶级大佬们纷纷站出来发声,呼吁暂停或至少放慢超级智能的研发进程。

这些大佬们的担忧并非空穴来风,随着AI技术的不断发展,超级智能有可能在未来的某一天超越人类的智慧和控制能力,从而引发一系列不可预知的后果,超级智能的研发还可能引发伦理、道德和法律等方面的挑战,对人类社会产生深远的影响。

顶级大佬的担忧与思考

1、潜在风险与不可预知后果

顶级大佬们普遍认为,超级智能的研发可能带来巨大的潜在风险,一旦超级智能超越了人类的智慧和控制能力,其可能产生的后果将是灾难性的,虽然目前AI技术已经取得了巨大的进步,但人类对于超级智能的真正能力和行为方式仍然知之甚少,暂停超级智能的研发可以给予人类更多的时间去研究和理解这一领域,以避免潜在的风险。

2、伦理、道德和法律挑战

除了潜在风险外,顶级大佬们还对超级智能的研发提出了伦理、道德和法律方面的担忧,随着AI技术的不断发展,如何确保AI的决策和行为符合人类的价值观和道德标准成为了一个亟待解决的问题,超级智能的研发还可能引发一系列法律问题,如知识产权、责任归属等,暂停超级智能的研发可以为人类提供更多的时间去研究和制定相应的伦理、道德和法律规范。

3、人类与AI的关系

顶级大佬们还关注到人类与AI的关系问题,随着AI技术的不断发展,人类与AI之间的互动将越来越频繁,如何确保这种互动是和谐、互利的?如何避免AI对人类产生负面影响?这些都是需要深入思考的问题,暂停超级智能的研发可以为人类提供更多的时间去研究和探索这一问题,以建立更加和谐的人机关系。

呼吁的影响与意义

顶级大佬们的这一呼吁引起了全球范围内的广泛关注和讨论,这一声音不仅反映了科技界对于超级智能潜在风险的担忧和思考,也提醒了人们应该更加谨慎地对待科技的发展,这一呼吁也促使了全球范围内的科技机构和科研机构开始重新审视自己的研究方向和目标,更加注重科技发展的可持续性和安全性。

未来的展望

虽然顶级大佬们呼吁暂停超级智能的研发,但这并不意味着人类应该放弃对AI技术的探索和研究,相反,我们应该更加谨慎地对待AI技术的发展和应用,确保其符合人类的价值观和道德标准,我们也需要加强对于AI技术的监管和管理,以避免其产生负面影响。

随着AI技术的不断发展,我们有望看到更加先进、智能的AI系统被广泛应用于各个领域,在追求科技进步的同时,我们也应该时刻保持警惕和谨慎的态度,确保科技的发展能够真正为人类带来福祉和进步。

顶级大佬们的呼吁提醒了我们应该更加谨慎地对待超级智能的研发和应用,在追求科技进步的同时,我们也应该关注其潜在的风险和挑战,并采取相应的措施来确保其符合人类的价值观和道德标准,我们才能实现真正的科技进步和社会发展。